Alex Saez

Engineering Manager & Software Craftsman

Engineering Manager & Software Craftsman

Si hace tiempo que no usás el modo de voz de ChatGPT, no te perdiste de mucho. Salvo un detalle: en TikTok sobran ejemplos de gente burlándose de lo torpe que puede llegar a ser. A veces ni hace falta irse muy lejos para notarlo: algo tan simple como preguntarle “si quiero lavar mi auto y el lavadero está cerca, ¿debería ir caminando o en auto?” alcanza para darse cuenta de que el modelo no viene siendo actualizado hace bastante tiempo.

Y no es solo una impresión. La diferencia entre lo que ofrece ChatGPT en voz y lo que están haciendo otros es demasiado notable. Parece como si OpenAI hubiera puesto el foco en los asistentes de codificación y dejado su asistente de voz para el final, mientras el resto del mercado seguía avanzando.

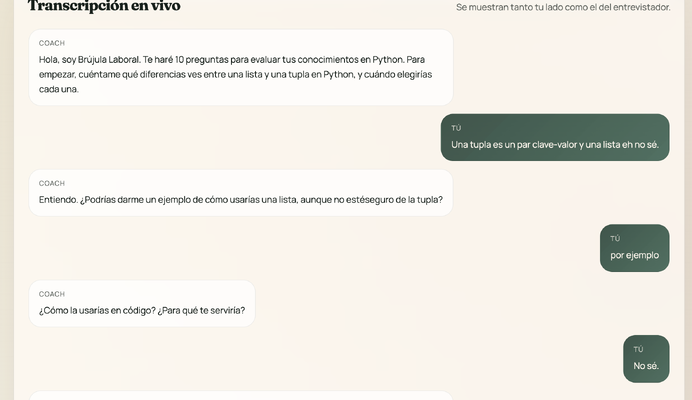

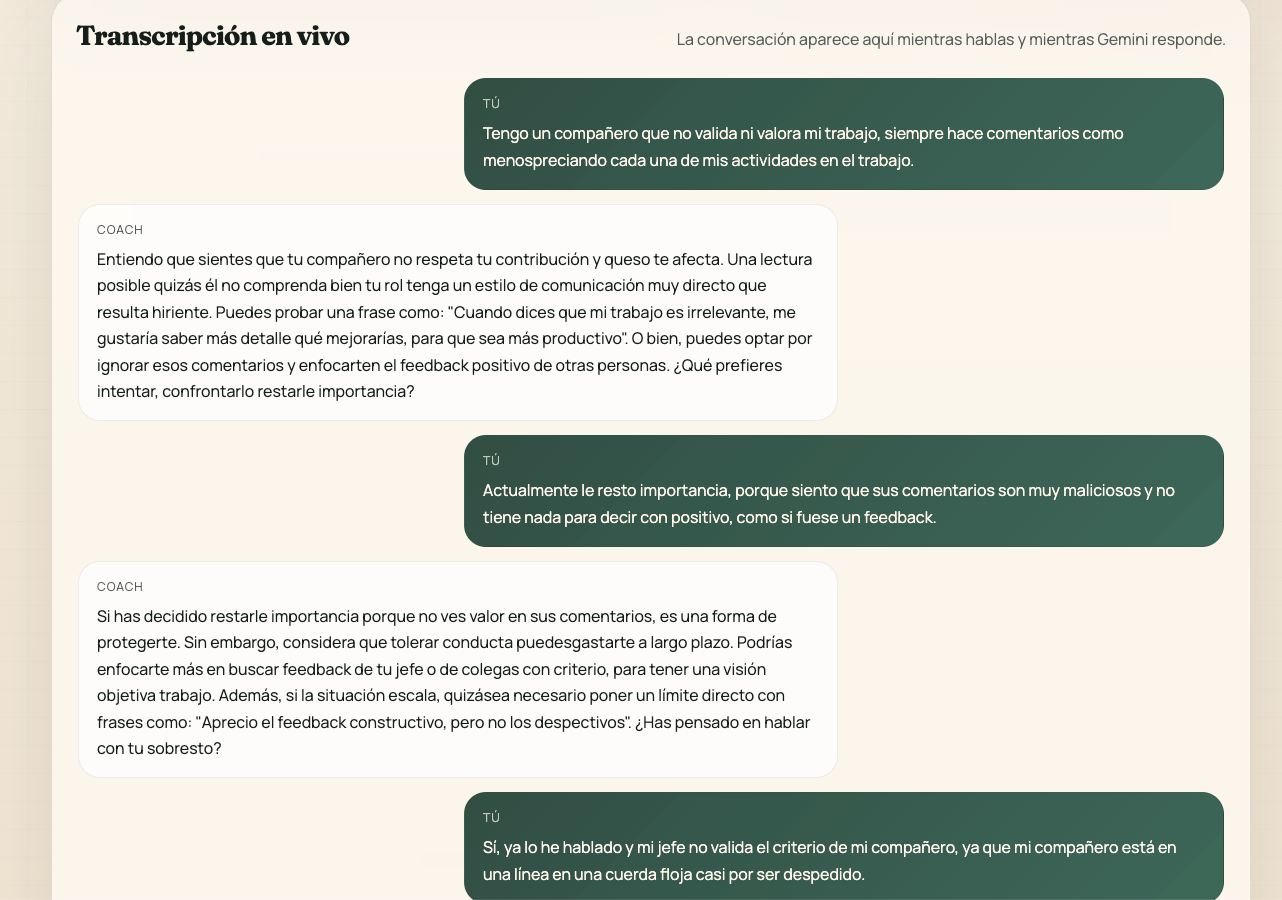

En un artículo anterior estuve probando modelos de voz locales para armar un simulador de entrevistas. El principal problema: todavía no daban el nivel para un producto realmente usable. Me había quedado pendiente investigar alternativas en la nube para agentes conversacionales, y así llegué a Gemini 3.1 Flash Live Preview.

Cuando salió, decidí probar el modelo live de Google, principalmente por su menor latencia frente a la versión estándar. Mi primer enfoque fue integrarlo con Google Agent Development Kit, pensé que iba a necesitar una capa agéntica para sumar inteligencia. En la práctica, no funcionó: la combinación no produjo nada usable, a pesar del tiempo invertido.

Después me acordé de una recomendación común al trabajar con skills: probar primero el modelo sin esa capa, porque a medida que mejora, puede volverse innecesaria. Apliqué esa misma idea. Eliminé Google ADK y, a partir de ahí, el sistema empezó a funcionar.

El último cambio fue sacar el backend como intermediario. En su lugar, el frontend se conecta directo a la API de Gemini Live vía WebSocket desde el navegador. Con eso se redujeron los microcortes y el voice agent quedó mucho más estable.

Si tuviera que destacar dos features del nuevo Gemini live serían:

Latencia bajísima: las respuestas llegan rápido, como si estuvieras hablando con una persona de verdad. No hay ese silencio incómodo que tenés que aguantar mientras el modelo “piensa”. Tambien es interesante porque no te interrumpe tanto como las primeras versiones de ChatGPT Voice.

Comprensión del contexto: entiende mejor lo que decís, incluso cuando hablás de forma natural, con muletillas, pausas o cuando cambiás de tema a mitad de conversación.

Calidad de voz: las voces suenan más naturales, con mejor entonación y ritmo. Ya no suena como un robot leyendo un texto.

Una cosa que aprendí en el proceso: no intentar construir el producto final desde el arranque. Yo empecé con un “Coach Laboral” minimalista, solo para validar que el stack técnico funcionaba. Recién una vez que eso estuvo estable pasé al simulador de entrevistas. Esa separación me ahorró horas de debugging en el lugar equivocado.

ChatGPT Voice Mode se quedó atrás, no hay vuelta que darle. Pero eso no quiere decir que no haya buenos modelos conversacionales. Incluso existen frameworks como livekit o plataformas enteras como ElevenLabs para el desarrollo de este tipo de agentes. Pero lo que a mi me sorprendió fue Gemini 3.1 Flash Live que sin necesidad de frameworks o capas agénticas adicionales permite obtener un agente conversacional en pocas iteraciones.

Si estás pensando en integrar voz en tu producto, me parece un excelente momento para experimentar. Las herramientas están, la tecnología maduró, y la brecha entre lo que se podía hacer antes y lo que se puede hacer ahora es enorme.

A partir de acá, la diferencia la hace la implementación.

PD: Para los que quieren chusmear el repo, acá está.